Malato di leucemia, segue i consigli dell’intelligenza artificiale per curarsi: morto a 73 anni

L’uomo statunitense si era convinto con l’autodiagnosi che le terapie proposte dai medici avrebbero peggiorato le sue condizioni

Un uomo di 73 anni, Joseph Neal Riley, è morto dopo aver rifiutato le cure indicate dall’oncologo e aver seguito i consigli di un chatbot di intelligenza artificiale, Perplexity. Circa diciotto mesi prima del decesso, a Riley erano stati diagnosticati un tumore al polmone, una malattia renale e una leucemia linfatica cronica. Come riporta il Corriere, se le prime due patologie erano state trattate con successo, la leucemia richiedeva un intervento rapido.

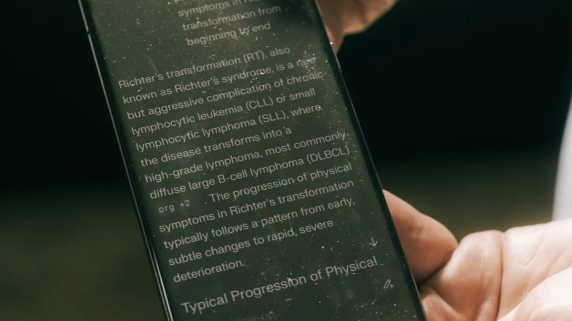

Lo specialista aveva infatti consigliato una terapia con Venetoclax e Obinutuzumab, trattamento di prima linea per questa forma tumorale. Nonostante il parere medico, Riley ha deciso di non iniziare la terapia. L’uomo, con un dottorato in neuroscienze e numerose pubblicazioni accademiche, si è affidato invece alle risposte fornite dal chatbot, con cui ha avviato un confronto sempre più frequente, anche a causa della sua paura degli ospedali. Convinto dall’intelligenza artificiale, Riley ha ritenuto di essere affetto dalla cosiddetta “trasformazione di Richter”, una complicanza aggressiva della leucemia. Questa autodiagnosi, rivelatasi errata, lo ha portato a credere che la terapia proposta avrebbe peggiorato le sue condizioni.

Nel tempo, il paziente ha condiviso con l’oncologo i report generati dal chatbot, suscitando perplessità tra i medici. Successivamente, il figlio Benjamin ha contattato i ricercatori citati nelle risposte dell’intelligenza artificiale: entrambi hanno chiarito che le conclusioni erano state fraintese e che il paziente avrebbe dovuto seguire le indicazioni cliniche. Riley ha accettato di iniziare il trattamento solo dopo molti mesi, quando però la malattia era ormai in fase avanzata. Il ritardo nelle cure ha portato al decesso. Dopo la morte del padre, il figlio ha raccontato la vicenda, sottolineando come l’intelligenza artificiale possa rafforzare convinzioni errate, soprattutto quando utilizzata senza il confronto con professionisti sanitari.